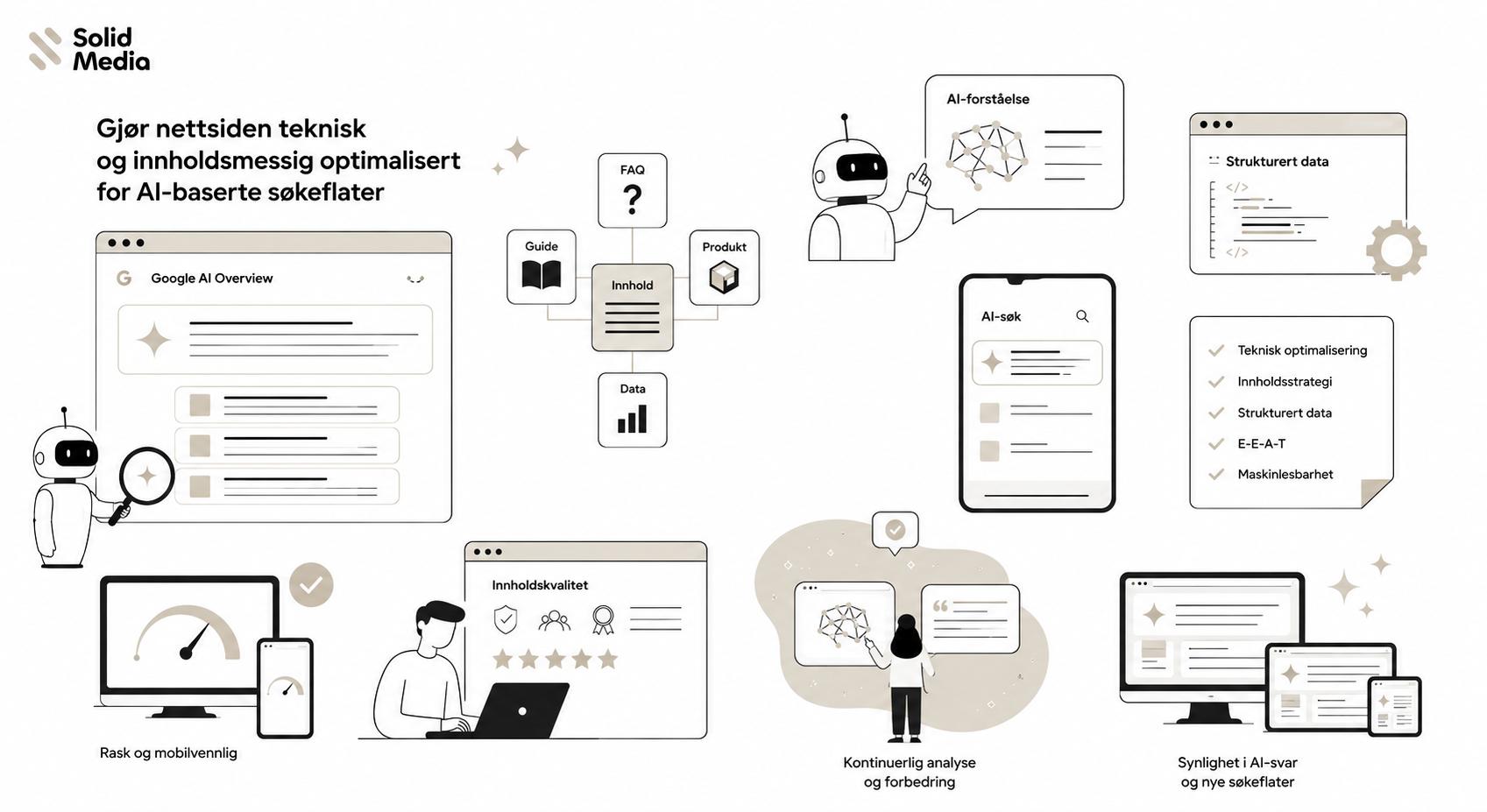

Kort oppsummert

- AI vurderer nettsiden din før kunden gjør det. Hvis innholdet ikke kan hentes og forstås teknisk, blir du i praksis valgt bort før du får vist frem kompetansen din.

- Synlighet i AI-søk handler om å bli valgt oftere. Når svarene er personaliserte, handler det mindre om én plassering og mer om sannsynligheten for å bli brukt som kilde i ulike situasjoner.

- Crawl, rendering og indeksering må sitte. Når disse tre fungerer sammen, legger du grunnlaget for at innholdet faktisk kan dukke opp i AI-genererte svar.

- Teknisk kvalitet er inngangsbilletten til synlighet. Fiks det grunnleggende først, så får innhold, autoritet og SEO-tiltak langt bedre effekt.

Når vi sier «AI og agenter», mener vi ikke bare språkmodeller som svarer på spørsmål i søk. Vi mener også AI-agenter som jobber på vegne av brukeren, for eksempel ved å hente informasjon, sammenligne alternativer, finne priser, oppsummere innhold og foreslå leverandører. For at du skal bli vurdert i slike prosesser, må innholdet ditt være teknisk tilgjengelig (crawles), synlig for roboter (renderes) og forståelig nok til å brukes videre (indekseres).

AI leser nettsiden din før brukeren gjør det

For mange bedrifter skaper AI usikkerhet rundt synlighet. Et vanlig spørsmål vi får er: «Vil kundene våre i det hele tatt finne oss, når AI i økende grad gir svar direkte i søk?» Bekymringen er høyst reell. Måten informasjon hentes og presenteres på har endret seg. Når AI-genererte svar vises direkte i søkeresultatet, faller klikkraten til vanlige nettsider. En analyse fra Ahrefs viser at trafikken kan falle med så mye som 34,5 %. Med andre ord: AI vurderer nettsiden din før et menneske gjør det. Hvis innholdet ikke er teknisk lesbart, blir du ikke med i vurderingen – og da er du ute av konkurransen før den har begynt.

Teknisk SEO avgjør om AI kan lese innholdet ditt. Struktur og tydelighet avgjør om AI velger å bruke det.

Kan AI faktisk lese nettsiden din?

Tidligere kunne godt innhold kompensere for tekniske svakheter. Slik er det ikke lenger. I dag fungerer AI som et mellomledd mellom deg og brukeren, og den har ingen tålmodighet med tekniske feil. Hvis AI ikke får tilgang til siden din, går den videre til neste kilde.

Derfor er teknisk lesbarhet ikke bare et SEO-tiltak. Det er en forutsetning for i det hele tatt å bli vurdert.

Hva betyr det at nettsiden må være lesbar for AI?

Å være lesbar handler ikke om skrivefeil eller formuleringer. Det handler om teknisk tilgjengelighet:

- Kan AI få tilgang til innholdet?

- Ser AI det samme som brukeren?

- Kan AI bruke og lagre informasjonen videre?

Dette kalles crawl, rendering og indeksering. Hvis ett av disse leddene svikter, stopper hele prosessen. La oss se nærmere på hva det betyr i praksis.

Crawl, rendering og indeksering – enkelt forklart

For at nettsiden din skal kunne brukes i AI-genererte svar, må tre tekniske steg fungere sammen. Det holder ikke at én av dem er på plass – alle må sitte. Tenk på det som en kjede. Ryker ett ledd, stopper hele prosessen. Og AI prøver ikke igjen senere. Den går videre til neste kilde.

1. Crawl: Får AI faktisk tilgang til nettsiden?

Crawl handler om tilgjengelighet. Når en AI-agent besøker domenet ditt, er det første spørsmålet den stiller: Får jeg lov til å hente dette innholdet – og slipper jeg faktisk inn? Hvis robots.txt, brannmur, CDN eller serveroppsett blokkerer AI-verktøy som GPTBot, ChatGPT-User eller PerplexityBot, får de ikke hentet innholdet ditt. Da kan de heller ikke analysere det, forstå det eller bruke det. Konsekvensen er enkel:

- Du blir ikke vurdert

- Du blir ikke analysert

- Du blir ikke brukt

Du eksisterer i praksis ikke for AI. Vi ser ofte at blokkeringer ligger igjen fra gamle testmiljøer eller sikkerhetsregler som ble lagt inn for å beskytte nettstedet. Intensjonen er god, men resultatet kan være at du også stenger ute fremtidens distribusjonskanaler. Crawl er inngangsdøren. Hvis den er stengt, stopper alt her.

2. Rendering: Ser AI det samme som brukeren?

La oss si at AI slipper inn. Neste spørsmål er: Ser den faktisk innholdet ditt slik brukeren gjør? Mange moderne nettsider er bygget slik at innhold lastes dynamisk via JavaScript. For brukeren fungerer dette fint – nettleseren kjører koden og bygger siden visuelt. Men AI-agenter rendrer ikke alltid siden på samme måte som en fullverdig nettleser. Hvis hovedinnholdet ditt først eksisterer etter at JavaScript har kjørt ferdig, risikerer du at AI-en kun ser:

- En tom struktur

- En ufullstendig side

- Fragmenter av innhold

- For deg ser siden helt riktig ut. For AI kan den i praksis være nesten tom.

Spesielt utsatt er:

- Produktsider der pris og beskrivelse lastes dynamisk

- Artikler som henter tekst via eksterne API-er

- Innhold som først lastes når brukeren scroller

- Tekst som er skjult bak interaksjoner eller samtykke

Rendering handler ikke om design eller animasjoner. Det handler om hvorvidt budskapet ditt faktisk finnes i HTML-koden når siden lastes. Hvis AI ikke ser innholdet, kan den heller ikke bruke det.

3. Indeksering: Kan innholdet forstås og brukes videre?

Selv om AI får tilgang og faktisk ser innholdet, gjenstår det siste – og ofte mest misforståtte – steget: Kan innholdet forstås, kategoriseres og brukes som kunnskapsgrunnlag? Her spiller tekniske signaler en avgjørende rolle. Noindex-tagger, feil bruk av canonical, duplisert innhold eller en forvirrende URL-struktur kan gjøre at innholdet blir ignorert – selv om det i utgangspunktet er tilgjengelig. AI-modeller og søkemotorer trenger tydelige signaler om:

- Hvilken side som er den primære kilden

- Hva siden faktisk handler om

- Hvordan den henger sammen med resten av nettstedet

- Hvilket tema og hvilken kontekst informasjonen tilhører

Hvis signalene er uklare, velger AI ofte en annen kilde som er enklere å tolke og strukturere. Indeksering handler derfor ikke bare om å bli lagret. Det handler om å bli forstått i riktig kontekst. Hvis crawl feiler → du blir ikke hentet. Hvis rendering feiler → du blir ikke forstått. Hvis indeksering feiler → du blir ikke brukt. AI har ingen insentiver til å «jobbe seg rundt» tekniske problemer. Den prioriterer kilder som er tilgjengelige, tydelige og effektive å hente. Det er derfor teknisk lesbarhet ikke bare er et SEO-tiltak. Det er selve forutsetningen for å være med i vurderingen.

AI-roboter "leser" ikke nettsiden din slik Google gjør. De hopper over komplisert design og teknisk støy. De prioriterer lynrask tilgang til ren informasjon. Hvis nettsiden din er teknisk tungvint, blir bedriften din rett og slett valgt bort av AI-en til fordel for en konkurrent som er lettere å forstå.

Typiske tekniske feil som gjør nettsider vanskelige å lese for AI

- Nettsiden er blokkert i robots.txt

- Brannmur, CDN eller sikkerhetsløsninger blokkerer crawlere (Googlebot, GPTBot, PerplexityBot)

- Viktige sider krever innlogging, cookies eller samtykke før innhold lastes inn

- Viktige sider returnerer feil statuskoder (3xx, 4xx, 5xx)

- Hovedinnhold lastes kun via JavaScript som ikke rendres for crawlere

Hva betyr synlighet i LLM-er når svarene er personaliserte?

I tradisjonell SEO handler det om å være «nummer én». Men med AI-søk er ikke plasseringen fast. To brukere kan stille samme spørsmål og få ulike svar. Derfor handler det ikke lenger bare om hvor du vises, men hvor ofte du er aktuell som svar. Teknisk lesbarhet øker sjansen for å bli valgt – igjen og igjen. Synlighet blir sannsynlighet.

For bedrifter betyr dette at teknisk kvalitet ikke lenger bare påvirker rangering, men om nettsiden i det hele tatt blir vurdert. AI har ingen insentiver til å ‘jobbe seg rundt’ tekniske problemer. Den går videre.

Teknisk sjekkliste: Slik gjør du nettsiden lesbar for AI

Bruk denne listen for å sikre at innholdet ditt når frem til språkmodellene. I AI-alderen er teknisk tilgjengelighet avgjørende for å i det hele tatt bli vurdert av AI-agenter. Et solid teknisk fundament har alltid vært viktig og overlapper i stor grad med tradisjonell SEO. Samtidig ser vi en endring i hva som prioriteres: Mens Googlebot historisk har vurdert autoritet og relevans i et bredt søkelandskap, er AI-agenter langt mer selektive og utålmodige. De prioriterer lynrask tilgang til maskinlesbar, strukturert informasjon og velger bort innhold som er teknisk tungvint å tolke. Ved å følge disse punktene fjerner du barrierene som hindrer roboter i å forstå merkevaren din og presentere den som et svar til potensielle kunder.

1. Valider robots.txt

Robots.txt fungerer som et sett med trafikkregler som forteller roboter hvilke deler av nettsiden de har lov til å besøke. Du må kontrollere at agenter som GPTBot, ChatGPT-User, CCBot eller PerplexityBot ikke blokkeres fra viktige mapper på grunn av gamle regler fra testmiljøer. Hvis du stenger døren her, vil ikke AI-modeller kunne lese innholdet ditt. Da blir du usynlig i fremtidens AI-genererte søkeresultater og sanntidssøk.

2. Unngå ompekingskjeder

Ompekninger er digitale omdirigeringer som automatisk sender en besøkende fra en gammel nettadresse til en ny. Sørg for at alle gamle sideversjoner leder direkte til den nyeste adressen uten unødvendige mellomstopp i lange kjeder. AI-agenter har et begrenset budsjett for ompekninger og vil ofte avbryte hvis de møter mer enn 2–3 mellomstasjoner før de når frem. Lange ompekingskjeder sløser bort crawl-budsjettet og øker risikoen for at siden rapporteres som utilgjengelig.

3. Lastetid (Time to First Byte)

Time to First Byte (TTFB) er tiden det tar før serveren din begynner å sende data. AI-agenter opererer med «crawl-budsjetter». Hvis serveren din bruker for lang tid på å svare, vil agenten ofte droppe siden din for å spare ressurser og gå videre til neste. Sikt på en responstid under 400 ms ved å bruke caching på servernivå eller ved å oppgradere hostingløsningen. AI-roboter er programmert til å prioritere raske kilder for å spare tid. En treg server blir raskt valgt bort til fordel for mer effektive nettsider.

4. Prioriter Server-Side Rendering (SSR)

Server-Side Rendering betyr at serveren bygger ferdige nettsider før de sendes ut, slik at innholdet ligger klart i HTML-koden når siden lastes. Hvis innholdet ditt krever at JavaScript kjører for å eksistere, risikerer du at AI-en kun ser rammeverket og ikke selve budskapet. AI-agenter har liten tålmodighet for kompleks koding som krever ekstra prosessering før lesing.

5. Unngå «lazy loading» på tekst

Unngå tekniske løsninger som gjør at tekst først lastes inn når brukeren scroller nedover siden. AI-agenter scroller sjelden slik et menneske gjør. De henter ofte bare det som er tilgjengelig i kildekoden ved første innlasting. Hvis viktig informasjon (som priser eller produktfordeler) er avhengig av scrolling for å trigge innlasting, vil AI-en sannsynligvis aldri se den. Bilder kan gjerne lastes senere for å spare hastighet, men tekst må være tilgjengelig umiddelbart.

6. Tekst må være tekst

Unngå å ha viktig informasjon låst inne i bildefiler eller avansert infografikk. Selv om moderne AI-modeller har blitt bedre på bildegjenkjenning (OCR), er det ressurskrevende og feilutsatt for en crawler å lese tekst fra et bilde. Råtekst i HTML er alltid førstevalget fordi det er søkbart, lett å kopiere og entydig for en maskin. Hvis du bruker infografikk, bør du inkludere en tekstlig oppsummering eller bruke tabeller og lister i koden for å formidle de samme dataene. Husk at alt-tekst er et godt supplement for universell utforming, men det erstatter ikke verdien av synlig, maskinlesbar brødtekst.

7. Ryddig overskriftshierarki

Bruk kun én H1 per side for å definere hovedtemaet, etterfulgt av logiske H2- og H3-nivåer som fungerer som AI-ens innholdsfortegnelse. Unngå å hoppe over nivåer i hierarkiet. Det bryter den semantiske strukturen og gjør det vanskeligere for maskiner å kartlegge informasjonens viktighet. Ved å bruke presise nøkkelord i overskriftene hjelper du roboten med å kategorisere relevansen av hver seksjon for spesifikke brukerbehov.

8. Implementer Schema Markup (JSON-LD)

Bruk strukturerte data for å gi AI-en en teknisk snarvei til faktaene på siden din. Dette maskinspråket fjerner behovet for tolkning ved å definere nøyaktige elementer som pris, forfatter eller FAQ direkte i koden. Det øker sjansen betydelig for at dataene dine blir foretrukket når AI-modeller skal gi presise svar.

9. Beskrivende URL-struktur og ankertekster

Sørg for en logisk URL-struktur som reflekterer innholdets tema, fremfor å bruke kryptiske parametere. En meningsfull adresse fungerer som et tidlig signal for AI-agenten om hva siden handler om før den er ferdig lastet. Bruk også beskrivende ankertekster i interne lenker for å hjelpe AI-en med å kartlegge relasjonen mellom ulike sider på nettstedet.

Slik tester du siden din på 60 sekunder

Robots-sjekken: Skriv dittdomene.no/robots.txt i nettleseren. Ser du agenter som GPTBot eller CCBot i listen over tillatte crawlere? Inkognitotesten: Åpne siden i et inkognitovindu. Kan du lese all viktig tekst uten å måtte interagere med cookie-banner eller samtykkepopups? JavaScript-testen: Bruk en utvidelse for å deaktivere JavaScript. Forsvinner viktig tekst eller priser? Hvis ja, har du et problem med rendering (SSR).

Oppsummert: Teknisk lesbarhet er inngangsbilletten

AI har ingen tålmodighet med tekniske problemer. Hvis noe ikke kan hentes, leses og brukes, hopper den videre. Derfor er teknisk lesbarhet ikke bare et SEO-tiltak – det er selve inngangsbilletten for å bli synlig i fremtidens søk. Start med å rydde opp i det tekniske, så stiller du langt sterkere i konkurransen om synlighet og kunder.

Trenger du hjelp?

Vi i Solid Media jobber hver dag med å hjelpe bedrifter med SEO og synlighet – og vet akkurat hva som skal til for at innholdet ditt blir AI-lesbart. Ta kontakt for en prat om hvordan vi kan hjelpe deg.